Фильтр Калмана — это легко

Время прочтения

18 мин

Просмотры 48K

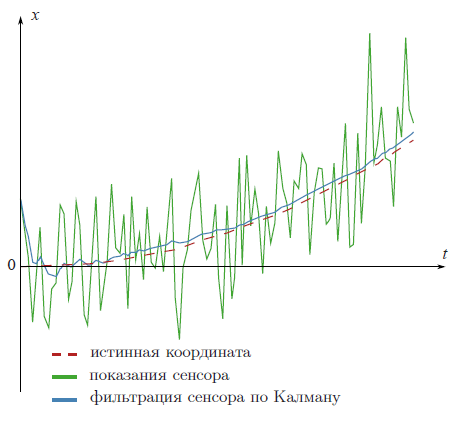

Много людей, в первый раз сталкивающихся в работе с датчиками, склонны считать, что получаемые показания — это точные значения. Некоторые вспоминают, что в показаниях всегда есть погрешности и ошибки. Чтобы ошибки в измерениях не приводили к ошибкам в функционировании системы в целом, данные датчиков необходимо обрабатывать. На ум сразу приходит словосочетание “фильтр Калмана”. Но слава этого “страшного” алгоритма, малопонятные формулы и разнообразие используемых обозначений отпугивают разработчиков. Постараемся разобраться с ним на практическом примере.

Об алгоритме

Что же нам потребуется для работы фильтра Калмана?

- Нам потребуется модель системы.

- Модель должна быть линейной (об этом чуть позже).

- Нужно будет выбрать переменные, которые будут описывать состояние системы (“вектор состояния”).

- Мы будем производить измерения и вычисления в дискретные моменты времени (например, 10 раз в секунду). Нам потребуется модель наблюдения.

- Для работы фильтра достаточно данных измерений в текущий момент времени и результатов вычислений с предыдущего момента времени.

Алгоритм работает итеративно. На каждом шаге алгоритм берёт данные датчиков (с шумом и другими проблемами), вектор состояния с предыдущего шага и по этим данным оценивает состояние системы на текущем шаге. Кроме того, он еще отслеживает насколько мы можем быть уверены, что наш текущий вектор состояний соответствует истинному положению дел (разброс значений для каждой переменной в векторе).

Обычно используются следующие обозначения:

— вектор состояния;

— мера неопределенности вектора состояния. Представляет из себя ковариационную матрицу (об этом позже — это будет, наверное, самая сложная часть).

Содержимое вектора состояния зависит от фантазии разработчика и решаемой задачи. Например, мы можем отслеживать координаты объекта, а также его скорость и ускорение. В этом случае получается вектор из трёх переменных: {позиция, скорость, ускорение} (для одномерного случая; для 3D мира будет по одному такому набору для каждой оси, то есть, 9 значений в векторе)

По сути, речь идёт о совместном распределении случайных величин

В фильтре Калмана мы предполагаем, что все погрешности и ошибки (как во входных данных, так и в оценке вектора состояния) имеют нормальное распределение. А для многомерного нормального распределения его полностью определяют два параметра: математическое ожидание вектора и его ковариационная матрица.

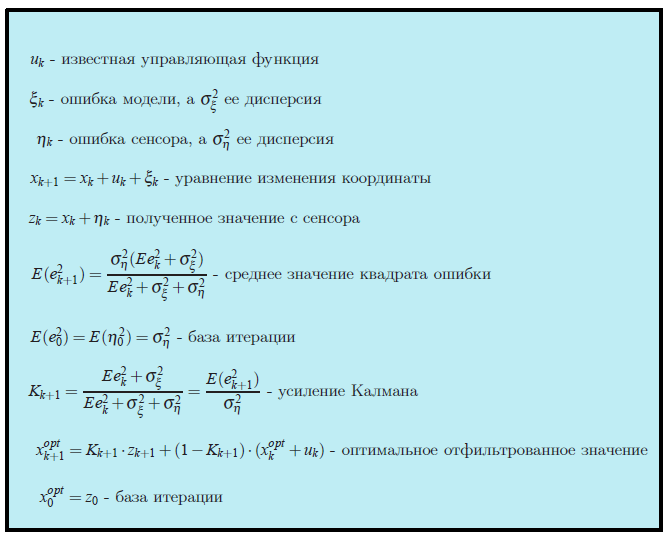

Математическая модель системы / процесса

Мы имеем дело с динамической системой, т.е. состояние системы меняется со временем. Имея модель системы, фильтр Калмана может предугадывать, каким будет состояние системы в следующий момент времени. Именно это позволяет фильтру так эффективно устранять шум и оценивать параметры, которые не наблюдаются (не измеряются) напрямую.

Фильтр Калмана накладывает ограничения на используемые модели: это должны быть дискретные модели в пространстве состояний. А ещё они должны быть линейными.

Дискретные и линейные?

Дискретность означает для нас то, что модель работает “шагами”. На каждом шаге мы вычисляем новое состояние системы по вектору состояния с предыдущего шага. Обычно, модели такого рода задаются системой разностных уравнений.

По поводу линейности: каждое уравнение системы является линейным уравнением, задающим новое значение переменной состояния. Т.е. никаких косинусов, синусов, возведений в степень и даже сложений с константой.

Такую модель удобно представлять в виде разностного матричного уравнения:

Давайте разберём это уравнение подробно. В первую очередь, нас интересует первое слагаемое () — это как раз модель эволюции процесса. А матрица

(также встречаются обозначения

,

) — называется матрицей процесса (state transition matrix). Она задаёт систему линейных уравнений, описывающих, как получается новое состояние системы из предыдущего.

Например, для равноускоренного движения матрица будет выглядеть так:

Первая строка матрицы — хорошо знакомое уравнение . Аналогично, вторая строка матрицы описывает изменение скорости. Третья строка описывает изменение ускорения.

А что же с остальными слагаемыми?

В некоторых случаях, мы напрямую управляем процессом (например, управляем квадракоптером с помощью пульта Д/У) и нам достоверно известны задаваемые параметры (заданная на пульте скорость полёта). Второе слагаемое — это модель управления. Матрица называется матрицей управления, а вектор

— вектор управляющих воздействий. В случаях когда мы только наблюдаем за процессом, это слагаемое отсутствует.

Последнее слагаемое — — это вектор ошибки модели. Модель равноускоренного движения абсолютно точно описывает положение объекта. Однако в реальном мире есть множество случайных факторов — дороги неровные, дует ветер, и т.п. Иногда, процесс сложен и приходится использовать упрощённую модель, которая не учитывает все аспекты. Именно так возникает ошибка модели.

То, что мы записываем это слагаемое, не означает, что мы знаем ошибку на каждом шаге или описываем её аналитически. Однако фильтр Калмана делает важное предположение — ошибка имеет нормальное распределение с нулевым математическим ожиданием и ковариационной матрицей . Эта матрица очень важна для стабильной работы фильтра и мы её рассмотрим позже.

Модель наблюдения

Не всегда получается так, что мы измеряем интересующие нас параметры напрямую (например, мы измеряем скорость вращения колеса, хотя нас интересует скорость автомобиля). Модель наблюдения описывает связь между переменными состояния и измеряемыми величинами:

— это вектор измерения/наблюдения.Это значения, получаемые с датчиков системы.

Первое слагаемое — модель, связывающая вектор состояния

с соответствующими ему показаниями датчиков. (Такой выбор модели может показаться странным, ведь наша задача — получить

из

, а эта модель получает

из

. Но это действительно так. В частности, это необходимо потому, что некоторые переменные состояния из

могут отсутствовать в

).

Второе слагаемое — это вектор ошибок измерения. Как и в случае с предыдущими ошибками, предполагается, что она имеет нормальное распределение с нулевым математическим ожиданием.

— ковариационная матрица, соответствующая вектору

.

Вернёмся к нашему примеру. Пусть у нас на роботе установлен один единственный датчик — GPS приёмник (“измеряет” положение). В этом случае матрица будет выглядеть следующим образом:

Строки матрицы соответствуют переменным в векторе состояния, столбцы — элементам вектора измерений. В первой строке матрицы находится значение “1” так как единица измерения положения в векторе состояния совпадает с единицей измерения значения в векторе измерений. Остальные строки содержат “0” потому что переменные состояния соответствующие этим строкам не измеряются датчиком.

Что будет, если датчик и модель используют разные единицы измерения? А если датчиков несколько?

Например, модель использует метры, а датчик — количество оборотов колеса. В этом случае матрица будет выглядеть так:

Количество датчиков ничем (кроме здравого смысла) не ограничено.

Например, добавим спидометр:

Второй столбец матрицы соответствует нашему новому датчику.

Несколько датчиков могут измерять один и тот же параметр. Добавим ещё один датчик скорости:

Ковариационные матрицы и где они обитают

Для настройки фильтра нам потребуется заполнить несколько ковариационных матриц:

,

и

.

Ковариационные матрицы?

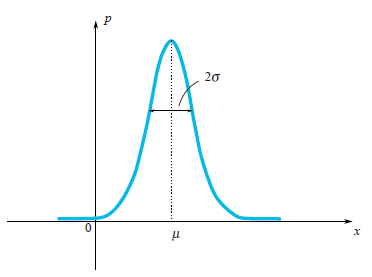

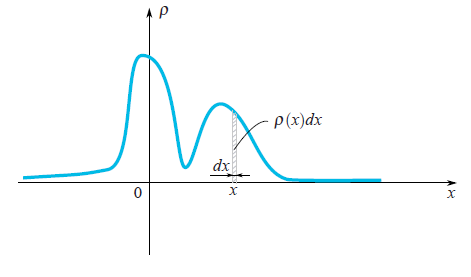

Для нормально распределенной случайной величины её математическое ожидание и дисперсия полностью определяют её распределение. Дисперсия — это мера разброса случайной величины. Чем больше дисперсия — тем сильнее может отклоняться случайная величина от её математического ожидания. Ковариационная матрица — это многомерный аналог дисперсии, для случая, когда у нас не одна случайная величина, а случайный вектор.

В одной статье сложно уместить всю теорию вероятностей, поэтому ограничимся сугубо практическими свойствами ковариационных матриц. Это симметричные квадратные матрицы, на главной диагонали которой располагаются дисперсии элементов вектора. Остальные элементы матрицы — ковариации между компонентами вектора. Ковариация показывает, насколько переменные зависят друг от друга.

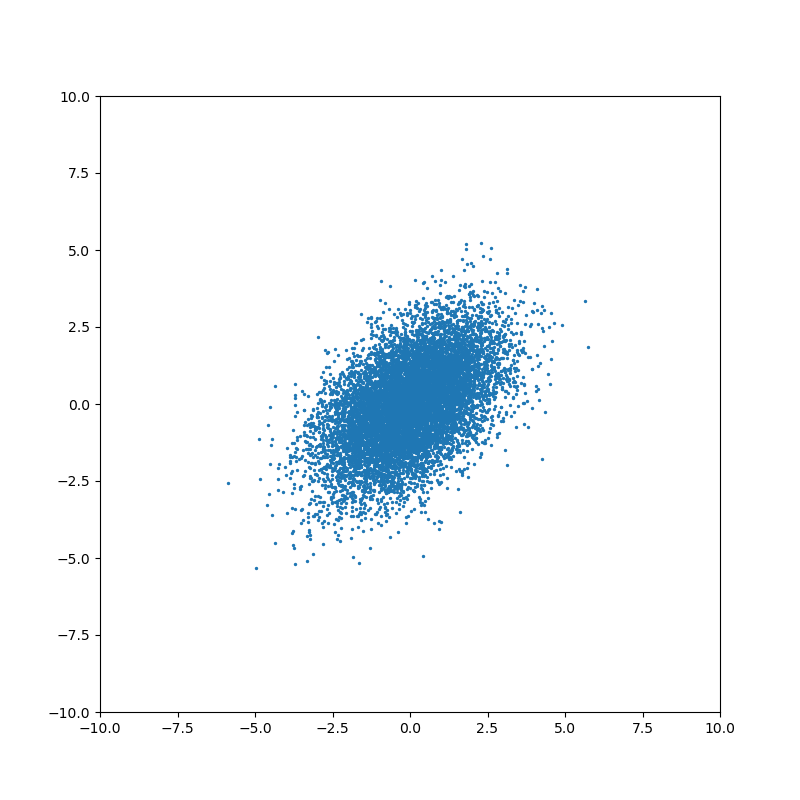

Проиллюстрируем влияние мат. ожидания, дисперсии и ковариации.

Начнём с одномерного случая. Функция плотности вероятности нормального распределения — знаменитая колоколообразная кривая. Горизонтальная ось — значение случайной величины, а вертикальная ось — сравнительная вероятность того что случайная величина примет это значение:

Чем меньше дисперсия — тем меньше ширина колокола.

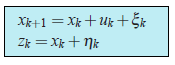

Понятие ковариации возникает для совместного распределения нескольких случайных величин. Когда случайные величины независимы, то ковариация равна нулю:

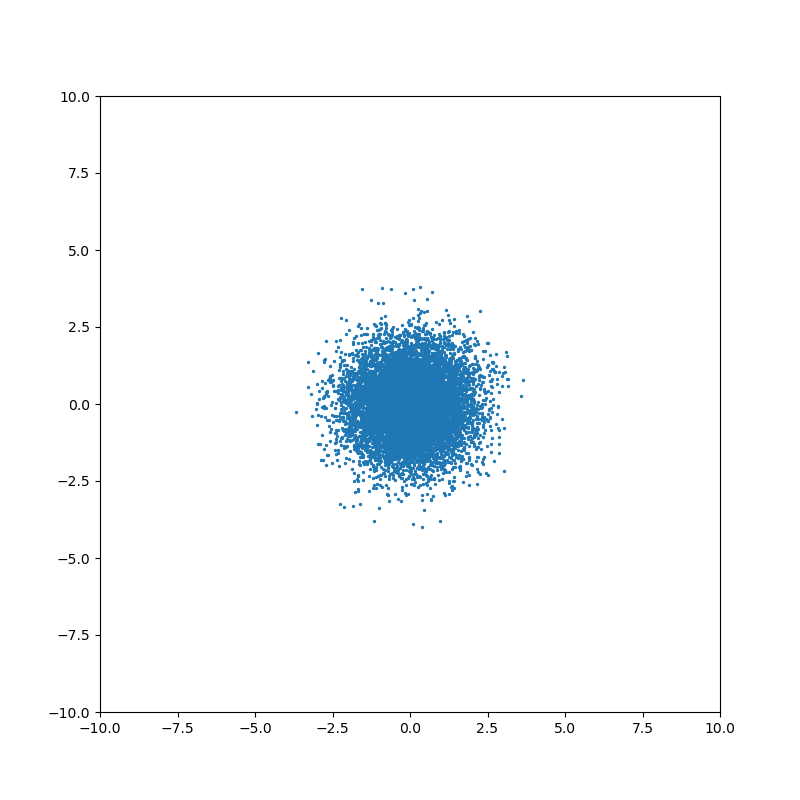

Ненулевое значение ковариации означает, что существует связь между значениями случайных величин:

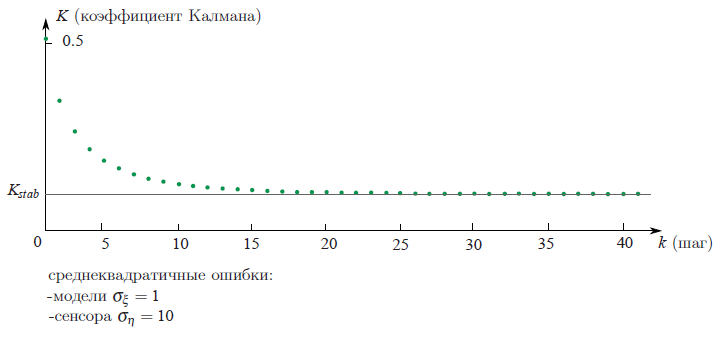

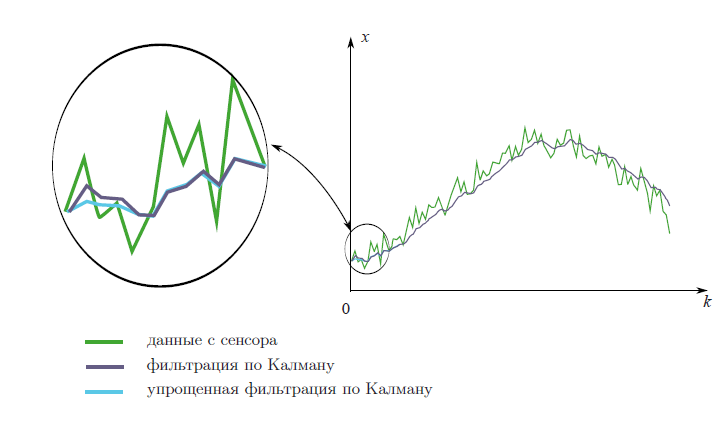

На каждом шаге фильтр Калмана строит предположение о состоянии системы, исходя из предыдущей оценки состояния и данных измерений. Если неопределенности вектора состояния выше, чем ошибка измерения, то фильтр будет выбирать значения ближе к данным измерений. Если ошибка измерения больше оценки неопределенности состояния, то фильтр будет больше “доверять” данным моделирования. Именно поэтому важно правильно подобрать значения ковариационных матриц — основного инструмента настройки фильтра.

Рассмотрим каждую матрицу подробнее:

— ковариационная матрица состояния

Квадратная матрица, порядок матрицы равен размеру вектора состояния

Как уже было сказано выше, эта матрица определяет “уверенность” фильтра в оценке переменных состояния. Алгоритм самостоятельно обновляет эту матрицу в процессе работы. Однако нам нужно установить начальное состояние, вместе с исходным предположением о векторе состояния.

Во многих случаях нам неизвестны значения ковариации между переменными для изначального состояния (элементы матрицы, расположенные вне главной диагонали). Поэтому можно проигнорировать их, установив равными 0. Фильтр самостоятельно обновит значения в процессе работы. Если же значения ковариации известны, то, конечно же, стоит использовать их.

Дисперсию же проигнорировать не выйдет. Необходимо установить значения дисперсии в зависимости от нашей уверенности в исходном векторе состояния. Для этого можно воспользоваться правилом трёх сигм: значение случайной величины попадает в диапазон с вероятностью 99.7%.

Пример

Допустим, нам нужно установить дисперсию для переменной состояния — скорости робота. Мы знаем что максимальная скорость передвижения робота — 10 м/с. Но начальное значение скорости нам неизвестно. Поэтому, мы выберем изначальное значение переменной — 0 м/с, а среднеквадратичное отклонение ;

Соответственно, дисперсия

.

— ковариационная матрица шума измерений

Квадратная матрица, порядок матрицы равен размеру вектора наблюдения (количеству измеряемых параметров).

Во многих случаях можно считать, что измерения не коррелируют друг с другом. В этом случае матрица будет являться диагональной матрицей, где все элементы вне главной диагонали равны нулю. Достаточно будет установить значения дисперсии для каждого измеряемого параметра. Иногда эти данные можно найти в документации к используемым датчика. Однако, если справочной информации нет, то можно оценить дисперсию, измеряя датчиком заранее известное эталонное значение, или воспользоваться правилом трёх сигм.

— ковариационная матрица ошибки модели

Квадратная матрица, порядок матрицы равен размеру вектора состояния.

С этой матрицей обычно возникает наибольшее количество вопросов. Что означает ошибка модели? Каков смысл этой матрицы и за что она отвечает? Как заполнять эту матрицу? Рассмотрим всё по порядку.

Каждый раз, когда фильтр предсказывает состояние системы, используя модель процесса, он увеличивает неуверенность в оценке вектора состояния. Для одномерного случая формула выглядит приблизительно следующим образом:

Если установить очень маленькое значение , то этап предсказания будет слабо увеличивать неопределенность оценки. Это означает, что мы считаем, что наша модель точно описывает процесс.

Если же установить большое значение , то этап предсказания будет сильно увеличивать неопределенность оценки. Таким образом, мы показываем что модель может содержать неточности или неучтенные факторы.

Для многомерного случая формула выглядит несколько сложнее, но смысл схожий. Однако, есть важное отличие: эта матрица указывает, на какие переменные состояния будут в первую очередь влиять ошибки модели и неучтённые факторы.

Допустим, мы отслеживаем перемещение робота, используя модель равноускоренного движения, и вектор состояния содержит следующие переменные: положение x, скорость v и ускорение a. Однако, наша модель не учитывает, что на дороге встречаются неровности.

Когда робот проходит неровность, показания датчиков и предсказание модели начнут расходиться. Структура матрицы будет определять, как фильтр отреагирует на это расхождение.

Мы можем выдвинуть различные предположения относительно природы шума. Для нашего примера с равноускоренным движением логично было бы предположить, что неучтённые факторы (неровность дороги) в первую очередь влияют на ускорение. Этот подход применим ко многим структурам модели, где в векторе состояния присутствует переменная и несколько её производных по времени (например, положение и производные: скорость и ускорение). Матрица выбирается таким образом, чтобы наибольшее значение соответствовало самому высокому порядку производной.

Так как же заполняется матрица Q?

Обычно используют модель-приближение. Рассмотрим на примере модели равноускоренного движения:

Модель непрерывного белого шума

Мы предполагаем, что ускорение постоянно на каждом шаге. Но из-за неровностей дороги ускорение, на самом деле, постоянно изменяется. Мы можем предположить, что изменение ускорения происходит под воздействием непрерывного белого шума с нулевым математическим ожиданием (т.е. усреднив все небольшие изменения ускорения за время движения робота мы получаем 0)

В этой модели матрица Q рассчитывается следующим образом

Мы формируем матрицу Qc в соответствии со структурой вектора состояния. Наивысшему порядку производной соответствует правый нижний элемент матрицы. В случае, если в векторе состояния несколько таких переменных, то каждая из них учитывается в матрице.

Для нашей модели равноускоренного движения матрица будет выглядеть так:

— спектральная плотность мощности белого шума

Подставляем матрицу процесса, соответствующую нашей модели:

После перемножения и интегрирования получаем:

Модель “кусочного” белого шума

Мы предполагаем, что ускорение на самом деле постоянно в течение каждого шага моделирования, но дискретно и независимо меняется между шагами. Выглядит очень похоже на предыдущую модель, но небольшая разница есть

— мощность шума

— наивысший порядок производной, используемой в модели (т.е. ускорение для вышеописанной модели)

В этой модели матрица определяется следующим образом:

Из матрицы процесса F

берём столбец с наивысшим порядком производной

и подставляем в формулу. В итоге получаем:

Обе модели являются приближениями того, что происходит на самом деле в реальности. На практике, приходится экспериментировать и выяснять, какая модель подходит лучше в каждом отдельном случае. Плюсом второй модели является то, что мы оперируем дисперсией шума, с которой уже хорошо умеем работать.

Простейший подход

В некоторых случаях прибегают к грубому упрощению: устанавливают все элементы матрицы равными нулю, за исключением элементов, соответствующих максимальным порядкам производных переменных состояния.

Действительно, если рассчитать по одному из приведённых выше методов, при достаточно малых значениях

, значения элементов матрицы

оказываются очень близкими к нулю.

Т.е. для нашей модели равноускоренного движения можно взять матрицу следующего вида:

И хотя такой подход не совсем корректен, его можно использовать в качестве первого приближения или для экспериментов. Без сомнения, не стоит выбирать матрицу таким образом для любых важных задач без весомых причин.

Важное замечание

Во всех примерах выше используется вектор состояния и может показаться, что во всех случаях дисперсия, соответствующая наивысшему порядок производной, находится в правом нижнем углу матрицы. Это не так.

Рассмотрим вектор состояния

Матрица будет представлять собой блочную матрицу, где отдельные блоки 3х3 элементов будут соответствовать группам

и

. Остальные элементы матрицы будут равны нулю.

Дисперсия, соответствующая наивысшим порядкам производных и

, будет находиться на 3-ей и 5-ой позициях на главной диагонали матрицы.

Однако, на практике нет никакого смысла перемешивать порядок переменных состояния таким образом, чтобы порядки производных шли не по очереди — это просто неудобно.

Пример кода

Нет смысла изобретать велосипед и писать свою собственную реализацию фильтра Калмана, когда существует множество готовых библиотек. Я выбрал язык python и библиотеку filterpy для примера.

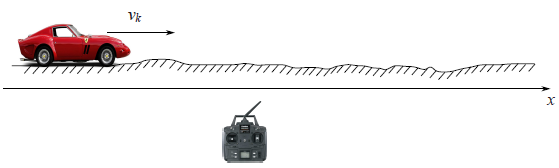

Чтобы не загромождать пример, возьмем одномерный случай. Одномерный робот оборудован одномерным GPS, который определяет положение с некоторой погрешностью.

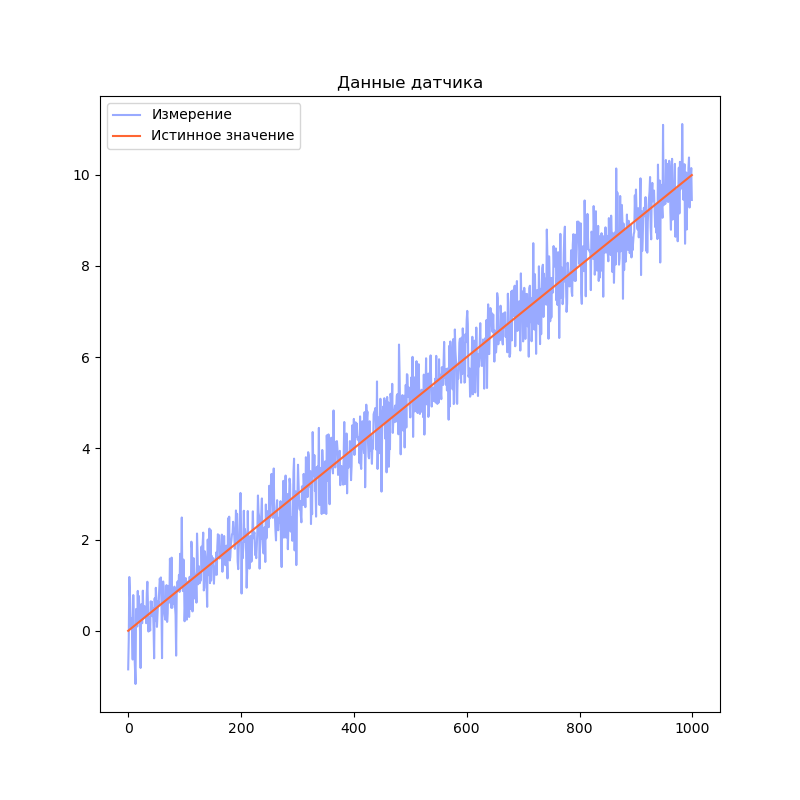

Моделирование данных датчиков

Начнём с равномерного движения:

Simulator.py

import numpy as np

import numpy.random

# Моделирование данных датчика

def simulateSensor(samplesCount, noiseSigma, dt):

# Шум с нормальным распределением. мат. ожидание = 0, среднеквадратичное отклонение = noiseSigma

noise = numpy.random.normal(loc = 0.0, scale = noiseSigma, size = samplesCount)

trajectory = np.zeros((3, samplesCount))

position = 0

velocity = 1.0

acceleration = 0.0

for i in range(1, samplesCount):

position = position + velocity * dt + (acceleration * dt ** 2) / 2.0

velocity = velocity + acceleration * dt

acceleration = acceleration

trajectory[0][i] = position

trajectory[1][i] = velocity

trajectory[2][i] = acceleration

measurement = trajectory[0] + noise

return trajectory, measurement # Истинное значение и данные "датчика" с шумом

Визуализируем результаты моделирования:

Код

import matplotlib.pyplot as plt

dt = 0.01

measurementSigma = 0.5

trajectory, measurement = simulateSensor(1000, measurementSigma, dt)

plt.title("Данные датчика")

plt.plot(measurement, label="Измерение", color="#99AAFF")

plt.plot(trajectory[0], label="Истинное значение", color="#FF6633")

plt.legend()

plt.show()

Реализация фильтра

Для начала выберем модель системы. Я решил взять 3 переменных состояния: положение, скорость и ускорение. В качестве модели процесса возьмем модель равноускоренного движения:

У нас единственный датчик, который напрямую измеряет положение. Поэтому модель наблюдения получается очень простой:

Мы предполагаем, что наш робот находится в точке 0 и имеет нулевые скорость и ускорение в начальный момент времени:

Однако, мы не уверены, что это именно так. Поэтому установим матрицу ковариации для начального состояния с большими значениями на главной диагонали:

Я воспользовался функцией библиотеки filterpy для расчёта ковариационной матрицы ошибки модели: filterpy.common.Q_discrete_white_noise. Эта функция использует модель непрерывного белого шума.

Код

import filterpy.kalman

import filterpy.common

import matplotlib.pyplot as plt

import numpy as np

import numpy.random

from Simulator import simulateSensor # моделирование датчиков

dt = 0.01 # Шаг времени

measurementSigma = 0.5 # Среднеквадратичное отклонение датчика

processNoise = 1e-4 # Погрешность модели

# Моделирование данных датчиков

trajectory, measurement = simulateSensor(1000, measurementSigma, dt)

# Создаём объект KalmanFilter

filter = filterpy.kalman.KalmanFilter(dim_x=3, # Размер вектора стостояния

dim_z=1) # Размер вектора измерений

# F - матрица процесса - размер dim_x на dim_x - 3х3

filter.F = np.array([ [1, dt, (dt**2)/2],

[0, 1.0, dt],

[0, 0, 1.0]])

# Матрица наблюдения - dim_z на dim_x - 1x3

filter.H = np.array([[1.0, 0.0, 0.0]])

# Ковариационная матрица ошибки модели

filter.Q = filterpy.common.Q_discrete_white_noise(dim=3, dt=dt, var=processNoiseVariance)

# Ковариационная матрица ошибки измерения - 1х1

filter.R = np.array([[measurementSigma*measurementSigma]])

# Начальное состояние.

filter.x = np.array([0.0, 0.0, 0.0])

# Ковариационная матрица для начального состояния

filter.P = np.array([[10.0, 0.0, 0.0],

[0.0, 10.0, 0.0],

[0.0, 0.0, 10.0]])

filteredState = []

stateCovarianceHistory = []

# Обработка данных

for i in range(0, len(measurement)):

z = [ measurement[i] ] # Вектор измерений

filter.predict() # Этап предсказания

filter.update(z) # Этап коррекции

filteredState.append(filter.x)

stateCovarianceHistory.append(filter.P)

filteredState = np.array(filteredState)

stateCovarianceHistory = np.array(stateCovarianceHistory)

# Визуализация

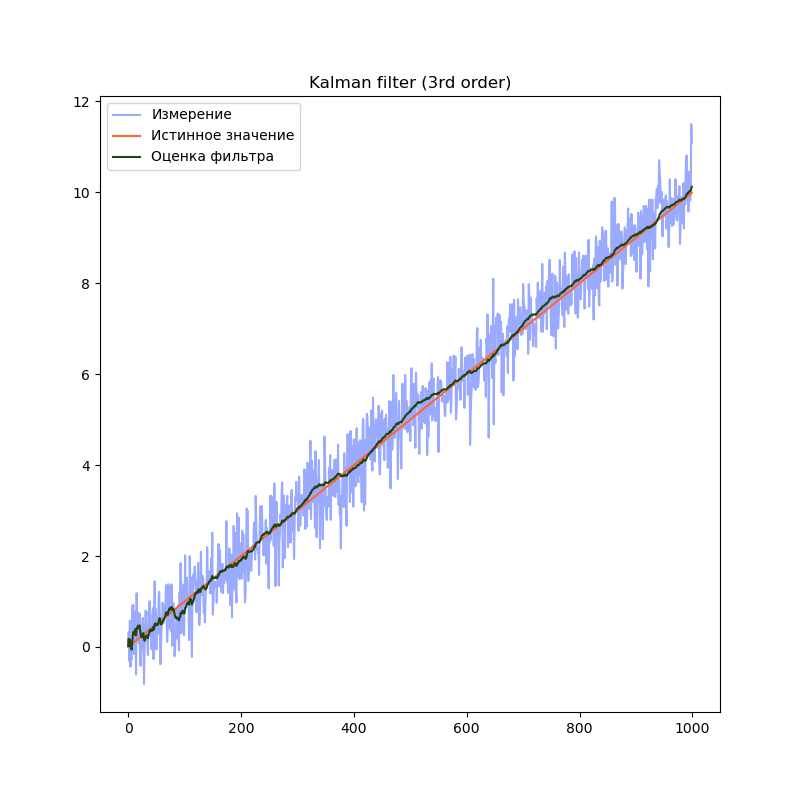

plt.title("Kalman filter (3rd order)")

plt.plot(measurement, label="Измерение", color="#99AAFF")

plt.plot(trajectory[0], label="Истинное значение", color="#FF6633")

plt.plot(filteredState[:, 0], label="Оценка фильтра", color="#224411")

plt.legend()

plt.show()

Бонус — сравнение различных порядков моделей

Сравним поведение фильтра с моделями разного порядка. Для начала, смоделируем более сложный сценарий поведения робота. Пусть робот находится в покое первые 20% времени, затем движется равномерно, а затем начинает двигаться равноускоренно:

Simulator.py

# Моделирование данных датчика

def simulateSensor(samplesCount, noiseSigma, dt):

# Шум с нормальным распределением. мат. ожидание = 0, среднеквадратичное отклонение = noiseSigma

noise = numpy.random.normal(loc = 0.0, scale = noiseSigma, size = samplesCount)

trajectory = np.zeros((3, samplesCount))

position = 0

velocity = 0.0

acceleration = 0.0

for i in range(1, samplesCount):

position = position + velocity * dt + (acceleration * dt ** 2) / 2.0

velocity = velocity + acceleration * dt

acceleration = acceleration

# Переход на равномерное движение

if(i == (int)(samplesCount * 0.2)):

velocity = 10.0

# Переход на равноускоренное движение

if (i == (int)(samplesCount * 0.6)):

acceleration = 10.0

trajectory[0][i] = position

trajectory[1][i] = velocity

trajectory[2][i] = acceleration

measurement = trajectory[0] + noise

return trajectory, measurement # Истинное значение и данные "датчика" с шумом

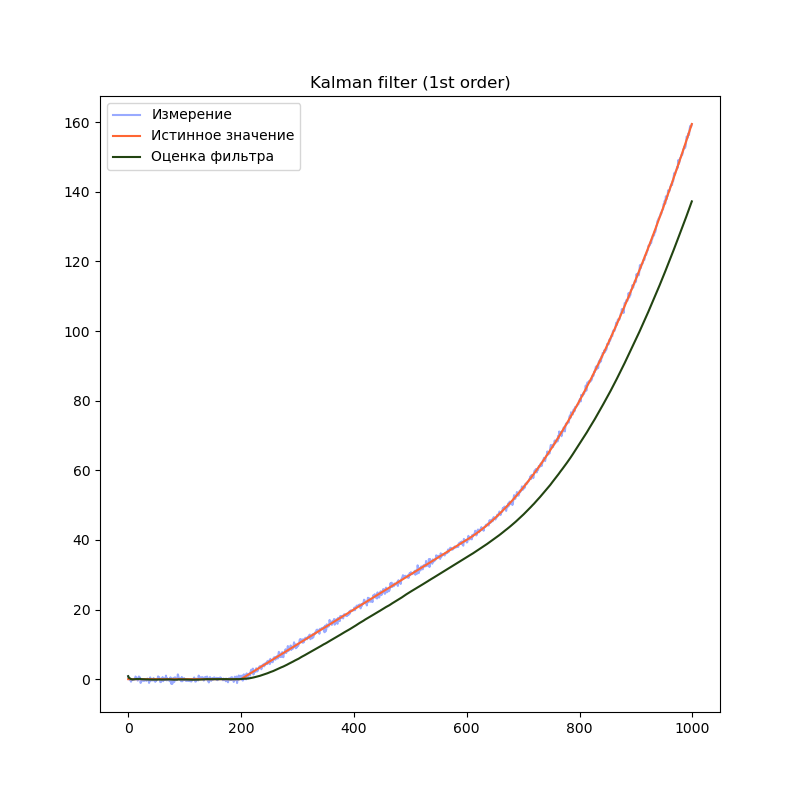

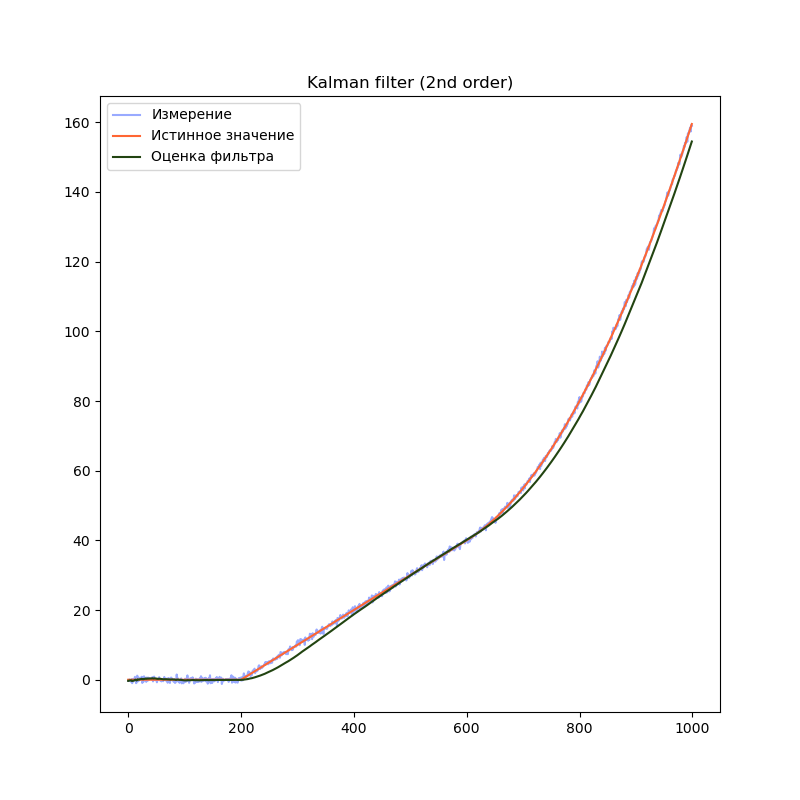

В предыдущем примере мы использовали модель, содержащую переменную (положение) и две производных её по времени (скорость и ускорение). Посмотрим, что будет, если избавиться от одной или обеих производных:

2-й порядок

# Создаём объект KalmanFilter

filter = filterpy.kalman.KalmanFilter(dim_x=2, # Размер вектора стостояния

dim_z=1) # Размер вектора измерений

# F - матрица процесса - размер dim_x на dim_x - 2х2

filter.F = np.array([ [1, dt],

[0, 1.0]])

# Матрица наблюдения - dim_z на dim_x - 1x2

filter.H = np.array([[1.0, 0.0]])

filter.Q = [[dt**2, dt],

[ dt, 1.0]] * processNoise

# Начальное состояние.

filter.x = np.array([0.0, 0.0])

# Ковариационная матрица для начального состояния

filter.P = np.array([[8.0, 0.0],

[0.0, 8.0]])

1-й порядок

# Создаём объект KalmanFilter

filter = filterpy.kalman.KalmanFilter(dim_x=1, # Размер вектора стостояния

dim_z=1) # Размер вектора измерений

# F - матрица процесса - размер dim_x на dim_x - 1х1

filter.F = np.array([ [1.0]])

# Матрица наблюдения - dim_z на dim_x - 1x1

filter.H = np.array([[1.0]])

# Ковариационная матрица ошибки модели

filter.Q = processNoise

# Ковариационная матрица ошибки измерения - 1х1

filter.R = np.array([[measurementSigma*measurementSigma]])

# Начальное состояние.

filter.x = np.array([0.0])

# Ковариационная матрица для начального состояния

filter.P = np.array([[8.0]])

Сравним результаты:

На графиках сразу заметно, что модель первого порядка начинает отставать от истинного значения на участках равномерного движения и равноускоренного движения. Модель второго порядка успешно справляется с участком равномерного движения, но так же начинает отставать на участке равноускоренного движения. Модель третьего порядка справляется со всеми тремя участками.

Однако, это не означает что нужно использовать модели высокого порядка во всех случаях. В нашем примере, модель третьего порядка справляется с участком равномерного движения несколько хуже модели второго порядка, т.к. фильтр интерпретирует шум сенсора как изменение ускорения. Это приводит к колебанию оценки фильтра. Стоит подбирать порядок модели в соответствии с планируемыми режимами работы фильтра.

Нелинейные модели и фильтр Калмана

Почему фильтр Калмана не работает для нелинейных моделей и что делать

Всё дело в нормальном распределении. При применении линейных преобразованийк нормально распределенной случайной величине, результирующее распределение будет представлять собой нормальное распределение, или будет пропорциональным нормальному распределению. Именно на этом принципе и строится математика фильтра Калмана.

Есть несколько модификаций алгоритма, которые позволяют работать с нелинейными моделями.

Например:

Extended Kalman Filter (EKF) — расширенный фильтр Калмана. Этот подход строит линейное приближение модели на каждом шаге. Для этого требуется рассчитать матрицу вторых частных производных функции модели, что бывает весьма непросто. В некоторых случаях, аналитическое решение найти сложно или невозможно, и поэтому используют численные методы.

Unscented Kalman Filter (UKF). Этот подход строит приближение распределения получающегося после нелинейного преобразования при помощи сигма-точек. Преимуществом этого метода является то, что он не требует вычисления производных.

Мы рассмотрим именно Unscented Kalman Filter

Unscented Kalman Filter и почему он без запаха

Основная магия этого алгоритма заключается в методе, который строит приближение распределения плотности вероятности случайной величины после прохождения через нелинейное преобразование. Этот метод называется unscented transform — сложнопереводимое на русский язык название. Автор этого метода, Джеффри Ульман, не хотел, чтобы его разработку называли “Фильтр Ульмана”. Согласно интервью, он решил назвать так свой метод после того как увидел дезодорант без запаха (“unscented deodorant”) на столе в лаборатории, где он работал.

Этот метод достаточно точно строит приближение функции распределения случайной величины, но что более важно — он очень простой.

Для использования UKF не придётся реализовывать какие-либо дополнительные вычисления, за исключением моделей системы. В общем виде, нелинейная модель не может быть представлена в виде матрицы, поэтому мы заменяем матрицы и

на функции

и

. Однако смысл этих моделей остаётся тем же.

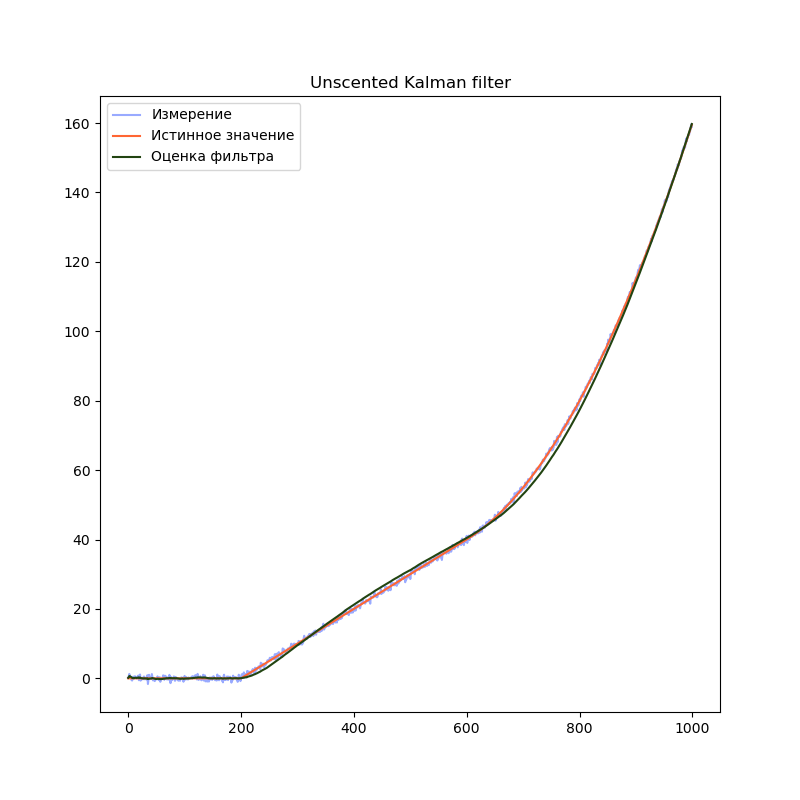

Реализуем unscented Kalman filter для линейной модели из прошлого примера:

Код

import filterpy.kalman

import filterpy.common

import matplotlib.pyplot as plt

import numpy as np

import numpy.random

from Simulator import simulateSensor, CovarianceQ

dt = 0.01

measurementSigma = 0.5

processNoiseVariance = 1e-4

# Функция наблюдения - аналог матрицы наблюдения

# Преобразует вектор состояния x в вектор измерений z

def measurementFunction(x):

return np.array([x[0]])

# Функция процесса - аналог матрицы процесса

def stateTransitionFunction(x, dt):

newState = np.zeros(3)

newState[0] = x[0] + dt * x[1] + ( (dt**2)/2 ) * x[2]

newState[1] = x[1] + dt * x[2]

newState[2] = x[2]

return newState

trajectory, measurement = simulateSensor(1000, measurementSigma)

# Для unscented kalman filter необходимо выбрать алгоритм выбора сигма-точек

points = filterpy.kalman.JulierSigmaPoints(3, kappa=0)

# Создаём объект UnscentedKalmanFilter

filter = filterpy.kalman.UnscentedKalmanFilter(dim_x = 3,

dim_z = 1,

dt = dt,

hx = measurementFunction,

fx = stateTransitionFunction,

points = points)

# Ковариационная матрица ошибки модели

filter.Q = filterpy.common.Q_discrete_white_noise(dim=3, dt=dt, var=processNoiseVariance)

# Ковариационная матрица ошибки измерения - 1х1

filter.R = np.array([[measurementSigma*measurementSigma]])

# Начальное состояние.

filter.x = np.array([0.0, 0.0, 0.0])

# Ковариационная матрица для начального состояния

filter.P = np.array([[10.0, 0.0, 0.0],

[0.0, 10.0, 0.0],

[0.0, 0.0, 10.0]])

filteredState = []

stateCovarianceHistory = []

for i in range(0, len(measurement)):

z = [ measurement[i] ]

filter.predict()

filter.update(z)

filteredState.append(filter.x)

stateCovarianceHistory.append(filter.P)

filteredState = np.array(filteredState)

stateCovarianceHistory = np.array(stateCovarianceHistory)

plt.title("Unscented Kalman filter")

plt.plot(measurement, label="Измерение", color="#99AAFF")

plt.plot(trajectory[0], label="Истинное значение", color="#FF6633")

plt.plot(filteredState[:, 0], label="Оценка фильтра", color="#224411")

plt.legend()

plt.show()

Разница в коде минимальна. Мы заменили матрицы F и H на функции f(x) и h(x). Это позволяет использовать нелинейные модели системы и/или наблюдения:

# Функция наблюдения - аналог матрицы наблюдения

# Преобразует вектор состояния x в вектор измерений z

def measurementFunction(x):

return np.array([x[0]])

# Функция процесса - аналог матрицы процесса

def stateTransitionFunction(x, dt):

newState = np.zeros(3)

newState[0] = x[0] + dt * x[1] + ( (dt**2)/2 ) * x[2]

newState[1] = x[1] + dt * x[2]

newState[2] = x[2]

return newStateТакже, появилась строчка, устанавливающая алгоритм генерации сигма-точек

points = filterpy.kalman.JulierSigmaPoints(3, kappa=0)

Этот алгоритм определяет точность оценки распределения вероятности при прохождении через нелинейное преобразование. К сожалению, существуют только общие рекомендации относительно генерации сигма-точек. Поэтому для каждой отдельной задачи значения параметров алгоритма подбираются экспериментальным путём.

Ожидаемый результат — график оценки положения практически не отличается от обычного фильтра Калмана.

В этом примере используется линейная модель. Однако мы могли бы использовать нелинейные функции. Например, мы могли бы использовать следующую реализацию:

g = 9.8

# Вектор состояния - угол наклона

# Вектор измерений - ускорение вдоль осей X и Y

def measurementFunction(x):

measurement = np.zeros(2)

measurement[0] = math.sin(x[0]) * g

measurement[1] = math.cos(x[0]) * g

return measurementТакую модель измерений было бы невозможно использовать в случае с линейным фильтром Калмана

Вместо заключения

За рамками статьи остались теоретические основы фильтра Калмана. Однако объем материала по этой теме ошеломляет. Сложно выбрать хороший источник. Я бы хотел рекомендовать замечательную книгу от автора библиотеки filterpy Roger Labbe (на английском языке). В ней доступно описаны принципы работы алгоритма и сопутствующая теория. Книга представляет собой документ Jupyter notebook, который позволяет в интерактивном режиме экспериментировать с примерами.

Литература

→ Roger Labbe — Kalman and Bayesian Filters in Python

→ Wikipedia

A “quick” review of Error State — Extended Kalman Filter

Recently in my job I had to work on implementing a Kalman Filter. My surprise was that there is an incredible lack of resources explaining with detail how Kaman Filter (KF) works. Imagine now the lack of resources explaining a more complex KF as the Error-state Extended Kaman Filter (ES-EKF). In this post, I will focus on the ES-EKF and leave UKF alone for now. One of the only blogs regarding a linear KF worth reading is kalman filter with images which I recommended. Here I will cover with more details the whole linear Kalman filter equations and how to derive them. After that, I will explain how to transform it into an Extended KF (EKF) and then how to transform it into an Error-state Extended KF (ES-EKF).

Notation

We will use Proper Euler angles to note rotations, that will be is (alpha, beta, gamma), we are only interested in 2D rotations, therefore, we will use the z-x’-z’’ representation in which (alpha) represents the yaw (the representation does not matter as far as the first rotation happens in the (z) axis). The steering angle will be noted by (delta).

Explanation

The Kalman Filter is used to keep track of certain variables and fuse information coming from other sensors such as Inertial Measurement Unit (IMU) or Wheels or any other sensor. It is very common in robotics because it fuses the information according to how certain the measurements are. Therefore we can have several sources of information, some more reliable than others and a KF takes that into account to keep track of the variables we are interested in.

The state (s_t) we are interested in tracking is composed by (x) and (y) coordinates, the heading of the vehicle or the yaw (theta), the current velocity (v) and steering angle (delta). The tracked orientation is only composed by the yaw (theta), we are only modelling a 2D world, therefore we do not care about the roll (beta) or pitch (gamma). And finally, we added the steering angle (delta) which is important to predict the movement of the car. Therefore the state in timestep (t) is

[s_t= left[begin{matrix}

x\y\theta\v\delta

end{matrix}right]]

KF can be divided into two steps, update and predict step. In the predict step, using the tracked information we predict where will the object move in the next step. In the update step, we update the belief we have about the variables using the external measurements coming from the sensors.

Sensor

Keep in mind that a KF can handle any number of sensors, so far we are going to use the localization measurement coming from a GPS + pseudo-gyro.

This measurement contains the global measurements ((x,y)) that avoid the system of drifting. This system (without global variables) is also called Dead reckoning. Dead reckoning or using a Kalman Filter without a global measurement is prone to cumulative errors, that means that the state will slowly diverge from the true value.

Prediction Step

We will track the state as a multivariable Gaussian distribution with mean (mu) and covariance (P). (mu_t) will be the expected value of the state using the information available (i.e. the mean of (s_t)). And the state will have a covariance matrix (P) which means how certain we are about our prediction. We will use (mu_{t-1}) and (u) to predict (mu_t). Here (u) is a control column-vector of any extra information we can use, for example, steering angle if we can have access to the steering of the car or the acceleration if we have access to it. (u) can be a vector of any size.

We will try to model everything using matrices but for now, we will use scalars, the new value of the state in (t) will be

[begin{align}

x_t &= x_{t-1} + vDelta t cos theta\

y_t &= y_{t-1} + vDelta t sin theta\

theta &= theta_{t-1}\

v_t &= v_{t-1}\

delta_t &= delta_{t-1}

end{align}]

Here we are making simplifying assumptions about the world. First, the velocity (v) and the steering (delta) of the next step will be the same as before which is a weak assumption. The strong assumption is that the heading or yaw of the car (theta) is the same. Notice we are not using the steering but we still track it, it will be useful later. We can incorporate the kinematic model here to make the prediction more robust. But that will be adding non-linearities (and so far it is a linear KF). For now, let’s work with a simple environment and later on we can make things more interesting.

This prediction can be re-formulated in matrix form as

[mu_t = Fmu_{t-1} + Bu]

Where (u) is a zero vector and (B) is a linear transformation from (u) into the same form of the state (s). Also, (F) would be ((F) has to be linear so far, in the EKF we will expand that to include non-linearities)

[F = left[begin{matrix}

1 & 0 & 0 & Delta tcostheta & 0 \

0 & 1 & 0 & Delta tsintheta & 0\

0 & 0 & 1 & 0 & 0\

0 & 0 & 0 & 1 & 0\

0 & 0 & 0 & 0 & 1

end{matrix}right]]

This will result in the same equations but using matrix notation. Rember now that we are modelling (s) as a multivariable gaussian distribution and we are keeping track of the mean (mu) of the state (s) and the covariance (P). Using the equations above we update the mean of the state, now we have to update the covariance of the state. Every time we predict we make small errors which add noise and results in a slightly less accurate prediction. The covariance (P) has to reflect this reduction in certainty. The way it is done with Gaussian distributions is that the distribution gets slightly more flat (i.e. the covariance “increase”).

In a single-variable gaussian distribution (y sim mathcal N (mu’,sigma^2)) the variance has the property that (text{var}(ky) = k^2text{var}(y)), where (k) is a scalar. In matrix notation that is (P_t = FP_{t-1}F^T). Now we have to take into account that we are adding (Bu), where (u) is the control vector and a gaussian variable with covariance (Q). The good thing about Gaussians is that the covariances of a sum of Gaussians is the sum of the covariances (if both random variables are independent). Having this into account we have.

[P_t = FP_{t-1}F^T+BQB^T]

And with this, we have finished prediction the state and updating its covariance.

Update step

In the update step, we receive a measurement (z) coming from a sensor. We use the sensor information to correct/update the belief we have about the state. The measurement is a random variable with covariance (R). This is where things get interesting. In this case, we have two Gaussians variables, the state best estimate (mu_t) and the measurement reading (z).

The best way to combine two Gaussians is by multiplying them together. By multiplying them together, if certain values have high certainty in both distributions, the result will be also a high in the product (very certain). If both values have low certainty, the product will be even lower. And if If only one is high and the other is not, then the result will lay between high and low certainty. So multiplication of Gaussians merges the information of both distributions taking into account how certain the values are (covariance).

The equations derived from multiplying two multivariate Gaussians are similar to the single variable case. We will derive them here and generalize that to matrix form.

Let’s suppose we have (x_1 sim mathcal N (mu_1,sigma_1^2)) and (x_2simmathcal N(mu_2,sigma_2^2)) (and they do not have anything to do with the state or measurement for now). Have in mind that both (x_1) and (x_2) live in the same vector space (x), therefore

[begin{align}

p(x_1) = frac 1 {sqrt{2pisigma_1^2}}e^{-frac{(x-mu_1)^2}{2sigma_2^2}} & & p(x_2) = frac 1 {sqrt{2pisigma_2^2}}e^{-frac{(x-mu_2)^2}{2sigma_2^2}}

end{align}]

by multiplying them together we obtain

[frac 1 {sqrt{2pisigma_1^2}}e^{-frac{(x-mu_1)^2}{2sigma_1^2}}frac 1 {sqrt{2pisigma_2^2}}e^{-frac{(x-mu_2)^2}{2sigma_2^2}}]

We also now about a very useful property of Gaussians: the product of Gaussians is also a gaussian distribution. Therefore, to know the result of fusing both Gaussians we have to write the equation above in a gaussian form.

[begin{align}

&=frac 1 {sqrt{2pisigma_1^2}}e^{-frac{(x-mu_1)^2}{2sigma_1^2}}frac 1 {sqrt{2pisigma_2^2}}e^{-frac{(x-mu_2)^2}{2sigma_2^2}}\

&=frac 1 {2pisigma_1^2sigma_2^2}e^{-left(frac{(x-mu_1)^2}{2sigma_1^2}+frac{(x-mu_2)^2}{2sigma_2^2}right)}\

end{align}]

Because we know the result will be a Gaussian distribution, we do not care about constant values (e.g. (2pisigma_1^2)), in fact, we only care about the exponent value, which I have to transform it into something similar to

[frac{(x-text{something})^2}{2text{something else}^2}]

Where (text{something}) will be the new mean and (text{something else}^2) will be the new covariance after multiplication. Therefore we will ignore all the other terms and focus on the exponent value.

[begin{align}

frac{(x-mu_1)^2}{2sigma_1^2}+frac{(x-mu_2)^2}{2sigma_2^2} &= frac{sigma_2^2(x-mu_1)^2+sigma_1^2(x-mu_2)^2}{2sigma_1^2sigma_2^2}\

&= frac{sigma_2^2x^2-2sigma_2^2mu_1x+sigma_2^2mu_1^2 + sigma_1^2x^2-2sigma_1^2mu_2x+sigma_1^2mu_2^2}{2sigma_1^2sigma_2^2}\

&= frac{x^2(sigma_2^2+sigma_1^2)-2x(sigma_2^2mu_1+sigma_1^2mu_2)}{2sigma_1^2sigma_2^2}+frac{sigma_2^2mu_1^2+sigma_1^2mu_2^2}{2sigma_1^2sigma_2^2}\

&= frac{(sigma_2^2+sigma_1^2)}{2sigma_1^2sigma_2^2}left(x^2-2xfrac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma^2+sigma_2^2}right)+frac{sigma_2^2mu_1^2+sigma_1^2mu_2^2}{2sigma_1^2sigma_2^2}\

end{align}]

The term on the right can be ignored because it is constant and goes out of the exponent. And the term in parenthesis resembles a perfect square trinomial lacking the last squared term.

[begin{align}

&= frac{(sigma_2^2+sigma_1^2)}{2sigma_1^2sigma_2^2}left(x^2-2xfrac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma^2+sigma_2^2}right)\

&= frac{(sigma_2^2+sigma_1^2)}{2sigma_1^2sigma_2^2}left(x^2-2xfrac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma^2+sigma_2^2} + left(frac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma^2+sigma_2^2}right)^2 — left(frac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma^2+sigma_2^2}right)^2 right)\

&= frac{(sigma_2^2+sigma_1^2)}{2sigma_1^2sigma_2^2}left(left(x-frac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma^2+sigma_2^2}right)^2 — left(frac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma^2+sigma_2^2}right)^2 right)\

end{align}]

Ignoring the second term because it is also a constant, the final result of the exponent value is

[frac{(sigma_2^2+sigma_1^2)}{2sigma_1^2sigma_2^2}left(x-frac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma_1^2+sigma_2^2}right)^2 = frac{left(x-frac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma_1^2+sigma_2^2}right)^2}{frac{2sigma_1^2sigma_2^2}{(sigma_2^2+sigma_1^2)}}]

In fact this final form does resemble a Gaussian distribution. The new mean will be what is in the parenhesis with (x) and the new covariance will be the denominator divided by 2. To simplify things further along the way, we will re write it like

[begin{align}

mu_{text{new}} &= frac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma_1^2+sigma_2^2}\

&= mu_1 + frac{sigma_2^2mu_1+sigma_1^2mu_2}{sigma_1^2+sigma_2^2} — mu_1\

&= mu_1 + frac{sigma_2^2mu_1+sigma_1^2mu_2-mu_1(sigma_1^2+sigma_2^2)}{sigma_1^2+sigma_2^2}\

&= mu_1 + frac{sigma_2^2mu_1+sigma_1^2mu_2-mu_1sigma_1^2-sigma_2^2mu_1}{sigma_1^2+sigma_2^2}\

&= mu_1 + frac{sigma_1^2(mu_2-mu_1)}{sigma_1^2+sigma_2^2}\

&= mu_1 + K(mu_2-mu_1)

end{align}]

where (K = sigma_1^2/(sigma_1^2+sigma_2^2)). For the variance we have

[begin{align}

sigma_text{new}&=frac{sigma_1^2sigma_2^2}{(sigma_2^2+sigma_1^2)}\

&=sigma_1^2 + frac{sigma_1^2sigma_2^2}{(sigma_2^2+sigma_1^2)} — sigma_1^2\

&=sigma_1^2 + frac{sigma_1^2sigma_2^2-sigma_1^2(sigma_2^2+sigma_1^2)}{sigma_2^2+sigma_1^2}\

&=sigma_1^2 + frac{sigma_1^2sigma_2^2-sigma_1^2sigma_2^2+sigma_1^4}{sigma_2^2+sigma_1^2}\

&=sigma_1^2 + frac{sigma_1^4}{sigma_2^2+sigma_1^2}\

&= sigma_1^2 + Ksigma_1^2

end{align}]

Now we need to transform that to matrix notation and change for the correct variables. (mu) and (z) are not in the same vector space, therefore to transform (x) into the same vector space as the measurement space we use the matrix (H). The final result will be

[begin{align}

K &= HP_{t-1}H^T(HP_{t-1}H^T+R)^{-1}\

Hmu_t &= Hmu_{t-1}+K(z-Hmu_{t-1})\

HP_tH^T &= HP_{t-1}H^T+KHP_{t-1}H^T

end{align}]

If we take one (H) out from the left of (K) and we end up with

[begin{align}

K &= P_{t-1}H^T(HP_{t-1}H^T+R)^{-1}\

Hmu_t &= Hmu_{t-1}+HK(z-Hmu_{t-1})\

HP_tH^T &= HP_{t-1}H^T+HKHP_{t-1}H^T

end{align}]

We can pre-multiply the second and third equation by (H^{-T}) and also post-multiply the third equation by (H^{-1}), The final result turns out to be in the state vector space (mu) and not in the measurement vector space (Hmu). The final result for the update step (which corresponds to the combination of two sources of information with different certainty levels) is

[begin{align}

K &= P_{t-1}H^T(HP_{t-1}H^T+R)^{-1}\

mu_t &= mu_{t-1}+K(z-Hmu_{t-1})\

P_t &= P_{t-1}+KHP_{t-1} = (I+KH)P_{t-1}

end{align}]

And that is it! The all the equations for a Linear Kalman Filter.

Prediction step

[begin{align}

mu_t &= Fmu_{t-1} + Bu\

P_t &= FP_{t-1}F^T+BQB^T

end{align}]

Update step:

[begin{align}

K &= PH^T(HPH^T+R)^{-1}\

mu_t &= mu_{t-1}+K(z-Hmu_{t-1})\

P_t &= P_{t-1}+KHP_{t-1} = (I+KH)P_{t-1}

end{align}]

Extended Kalman Filter

In reality, the world does not behave linearly. The way KF deals with non-linearities is by using the jacobian to linearize the equation. We can expand this model to a non-linear proper KF modifying the prediction step by adding a simple kinematic model, for example, a bicycle kinematic model.

If we model everything from the centre of gravity of the vehicle, the equations for the bicycle kinematic model are

[begin{align}

dot x &= vcos (theta+beta)\

dot y &= vsin(theta+beta)\

dot theta &= frac{vcos(beta)tan(delta)}{L}\

beta &= tan^{-1}left(frac{l_rtandelta}{L}right)

end{align}]

Where (theta) is the heading of the vehicle (yaw), (beta) is the slip angle of the centre of gravity, (L) is the length of the vehicle, (l_r) is the length between the rearmost part to the centre of gravity and (delta) is the steering angle. In discrete-time form, we will have

[begin{align}

x_t &= x_{t-1}+Delta t cdot vcos (theta+beta)\

y_t &= y_{t-1}+Delta t cdot vsin(theta+beta)\

theta_t &= theta_{t-1} +Delta tcdot frac{vcos(beta)tan(delta)}{L}\

beta_t &= tan^{-1}left(frac{l_rtandelta_{t-1}}{L}right)\

v_t &= v_{t-1}\

delta_t &= delta_{t-1}

end{align}]

If you define that system of equations as (mathbf f(x,y,theta,v,delta)inmathbb R^6) then we can model the whole system using (mathbf f) and (F=partial f_j/partial x_i). We can also use the same trick with the transformation from state space (s) into measurement vector space (z).

We can also add non-linearities in the measurement. Before we used the matrix (H) now we can use the function (mathbf h(cdot)) and define (H) as (H=partial h_i/partial x_i). The final Extended Kalman Filter is

Prediction step

[begin{align}

mu_t &= mathbf f(mu_{t-1}) + Bu\

P_t &= FP_{t-1}F^T+BQB^T\

end{align}]

Update step:

[begin{align}K &= P_{t-1}H^T(HP_{t-1}H^T+R)^{-1}\

mu_t &= mu_{t-1}+K(z-mathbf h(mu_{t-1}))

\P_t &= (I+KH)P_{t-1}

end{align}]

##

Error state — Extended Kalman Filter

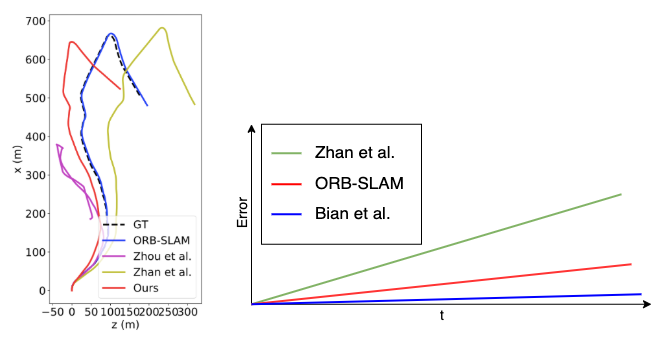

EKF is not a perfect method to estimate and predict the state, it will always make mistakes when predicting. The longer the number of sequential predictions without updates, the bigger the accumulated error. One interesting common property of the errors is that they have less complex behaviour than the state itself. This can be seen easier in the image below. While the behaviour of the position is highly non-linear, the error (estimation — ground truth) behaves much closer to a linear behaviour.

left image taken from “Unsupervised Scale-consistent Depth and Ego-motion Learning from Monocular Video”.

Therefore modelling the error of the state (i.e. error-state) is more likely that will be model correctly by a linear model. Therefore, we can avoid some noise coming from trying to model highly non-linear behaviour by modelling the error-state. Let’s define the error-state as (e=mu_t-mu_{t-1}). We can approximate (mathbf f(mu_{t-1})) using the Taylor series expansion only using the first derivative. Therefore (mathbf f(mu_{t-1}) approx mu_{t-1} + Fe_{t-1}). Replacing this and rearranging equation we end up with the final equations for the Error state — Extended Kalman Filter (ES-EKF)

Prediction step

[begin{align}

s_t &= mathbf f(s_{t-1},u)\

P_t &= FP_{t-1}F^T+BQB^T\

end{align}]

Update step:

[begin{align}K &= PH^T(HPH^T+R)^{-1}\

e_t &= K(z-h(mu_{t-1}))\

s_t &= s_{t-1} + e_t\

P_t &= (I+KH)P_{t-1}

end{align}]

Keep in mind that now we are tracking the error state and the covariance of the error, therefore we need to predict the state (s_t) and correct it by using the error-state during the update step, otherwise, we can estimate the state directly using (mathbf f(cdot)) as in ithe prediction step.

(if you see I have made a mistake, don’t hesitate to tell me).

The Kalman filter keeps track of the estimated state of the system and the variance or uncertainty of the estimate. The estimate is updated using a state transition model and measurements.

For statistics and control theory, Kalman filtering, also known as linear quadratic estimation (LQE), is an algorithm that uses a series of measurements observed over time, including statistical noise and other inaccuracies, and produces estimates of unknown variables that tend to be more accurate than those based on a single measurement alone, by estimating a joint probability distribution over the variables for each timeframe. The filter is named after Rudolf E. Kálmán, who was one of the primary developers of its theory.

This digital filter is sometimes termed the Stratonovich–Kalman–Bucy filter because it is a special case of a more general, nonlinear filter developed somewhat earlier by the Soviet mathematician Ruslan Stratonovich.[1][2][3][4] In fact, some of the special case linear filter’s equations appeared in papers by Stratonovich that were published before summer 1960, when Kalman met with Stratonovich during a conference in Moscow.[5]

Kalman filtering[6] has numerous technological applications. A common application is for guidance, navigation, and control of vehicles, particularly aircraft, spacecraft and ships positioned dynamically.[7] Furthermore, Kalman filtering is a concept much applied in time series analysis used for topics such as signal processing and econometrics. Kalman filtering is also one of the main topics of robotic motion planning and control[8][9] and can be used for trajectory optimization.[10] Kalman filtering also works for modeling the central nervous system’s control of movement. Due to the time delay between issuing motor commands and receiving sensory feedback, the use of Kalman filters[11] provides a realistic model for making estimates of the current state of a motor system and issuing updated commands.[12]

The algorithm works by a two-phase process. For the prediction phase, the Kalman filter produces estimates of the current state variables, along with their uncertainties. Once the outcome of the next measurement (necessarily corrupted with some error, including random noise) is observed, these estimates are updated using a weighted average, with more weight being given to estimates with greater certainty. The algorithm is recursive. It can operate in real time, using only the present input measurements and the state calculated previously and its uncertainty matrix; no additional past information is required.

Optimality of Kalman filtering assumes that errors have a normal (Gaussian) distribution. In the words of Rudolf E. Kálmán: «In summary, the following assumptions are made about random processes: Physical random phenomena may be thought of as due to primary random sources exciting dynamic systems. The primary sources are assumed to be independent gaussian random processes with zero mean; the dynamic systems will be linear.»[13] Though regardless of Gaussianity, if the process and measurement covariances are known, the Kalman filter is the best possible linear estimator in the minimum mean-square-error sense.[14]

Extensions and generalizations of the method have also been developed, such as the extended Kalman filter and the unscented Kalman filter which work on nonlinear systems. The basis is a hidden Markov model such that the state space of the latent variables is continuous and all latent and observed variables have Gaussian distributions. Kalman filtering has been used successfully in multi-sensor fusion,[15] and distributed sensor networks to develop distributed or consensus Kalman filtering.[16]

History[edit]

The filtering method is named for Hungarian émigré Rudolf E. Kálmán, although Thorvald Nicolai Thiele[17][18] and Peter Swerling developed a similar algorithm earlier. Richard S. Bucy of the Johns Hopkins Applied Physics Laboratory contributed to the theory, causing it to be known sometimes as Kalman–Bucy filtering.

Stanley F. Schmidt is generally credited with developing the first implementation of a Kalman filter. He realized that the filter could be divided into two distinct parts, with one part for time periods between sensor outputs and another part for incorporating measurements.[19] It was during a visit by Kálmán to the NASA Ames Research Center that Schmidt saw the applicability of Kálmán’s ideas to the nonlinear problem of trajectory estimation for the Apollo program resulting in its incorporation in the Apollo navigation computer.[20]: 16

This Kalman filtering was first described and developed partially in technical papers by Swerling (1958), Kalman (1960) and Kalman and Bucy (1961).

The Apollo computer used 2k of magnetic core RAM and 36k wire rope […]. The CPU was built from ICs […]. Clock speed was under 100 kHz […]. The fact that the MIT engineers were able to pack such good software (one of the very first applications of the Kalman filter) into such a tiny computer is truly remarkable.

— Interview with Jack Crenshaw, by Matthew Reed, TRS-80.org (2009) [1]

Kalman filters have been vital in the implementation of the navigation systems of U.S. Navy nuclear ballistic missile submarines, and in the guidance and navigation systems of cruise missiles such as the U.S. Navy’s Tomahawk missile and the U.S. Air Force’s Air Launched Cruise Missile. They are also used in the guidance and navigation systems of reusable launch vehicles and the attitude control and navigation systems of spacecraft which dock at the International Space Station.[21]

Overview of the calculation[edit]

Kalman filtering uses a system’s dynamic model (e.g., physical laws of motion), known control inputs to that system, and multiple sequential measurements (such as from sensors) to form an estimate of the system’s varying quantities (its state) that is better than the estimate obtained by using only one measurement alone. As such, it is a common sensor fusion and data fusion algorithm.

Noisy sensor data, approximations in the equations that describe the system evolution, and external factors that are not accounted for, all limit how well it is possible to determine the system’s state. The Kalman filter deals effectively with the uncertainty due to noisy sensor data and, to some extent, with random external factors. The Kalman filter produces an estimate of the state of the system as an average of the system’s predicted state and of the new measurement using a weighted average. The purpose of the weights is that values with better (i.e., smaller) estimated uncertainty are «trusted» more. The weights are calculated from the covariance, a measure of the estimated uncertainty of the prediction of the system’s state. The result of the weighted average is a new state estimate that lies between the predicted and measured state, and has a better estimated uncertainty than either alone. This process is repeated at every time step, with the new estimate and its covariance informing the prediction used in the following iteration. This means that Kalman filter works recursively and requires only the last «best guess», rather than the entire history, of a system’s state to calculate a new state.

The measurements’ certainty-grading and current-state estimate are important considerations. It is common to discuss the filter’s response in terms of the Kalman filter’s gain. The Kalman-gain is the weight given to the measurements and current-state estimate, and can be «tuned» to achieve a particular performance. With a high gain, the filter places more weight on the most recent measurements, and thus conforms to them more responsively. With a low gain, the filter conforms to the model predictions more closely. At the extremes, a high gain close to one will result in a more jumpy estimated trajectory, while a low gain close to zero will smooth out noise but decrease the responsiveness.

When performing the actual calculations for the filter (as discussed below), the state estimate and covariances are coded into matrices because of the multiple dimensions involved in a single set of calculations. This allows for a representation of linear relationships between different state variables (such as position, velocity, and acceleration) in any of the transition models or covariances.

Example application[edit]

As an example application, consider the problem of determining the precise location of a truck. The truck can be equipped with a GPS unit that provides an estimate of the position within a few meters. The GPS estimate is likely to be noisy; readings ‘jump around’ rapidly, though remaining within a few meters of the real position. In addition, since the truck is expected to follow the laws of physics, its position can also be estimated by integrating its velocity over time, determined by keeping track of wheel revolutions and the angle of the steering wheel. This is a technique known as dead reckoning. Typically, the dead reckoning will provide a very smooth estimate of the truck’s position, but it will drift over time as small errors accumulate.

For this example, the Kalman filter can be thought of as operating in two distinct phases: predict and update. In the prediction phase, the truck’s old position will be modified according to the physical laws of motion (the dynamic or «state transition» model). Not only will a new position estimate be calculated, but also a new covariance will be calculated as well. Perhaps the covariance is proportional to the speed of the truck because we are more uncertain about the accuracy of the dead reckoning position estimate at high speeds but very certain about the position estimate at low speeds. Next, in the update phase, a measurement of the truck’s position is taken from the GPS unit. Along with this measurement comes some amount of uncertainty, and its covariance relative to that of the prediction from the previous phase determines how much the new measurement will affect the updated prediction. Ideally, as the dead reckoning estimates tend to drift away from the real position, the GPS measurement should pull the position estimate back toward the real position but not disturb it to the point of becoming noisy and rapidly jumping.

Technical description and context[edit]

The Kalman filter is an efficient recursive filter estimating the internal state of a linear dynamic system from a series of noisy measurements. It is used in a wide range of engineering and econometric applications from radar and computer vision to estimation of structural macroeconomic models,[22][23] and is an important topic in control theory and control systems engineering. Together with the linear-quadratic regulator (LQR), the Kalman filter solves the linear–quadratic–Gaussian control problem (LQG). The Kalman filter, the linear-quadratic regulator, and the linear–quadratic–Gaussian controller are solutions to what arguably are the most fundamental problems of control theory.

In most applications, the internal state is much larger (has more degrees of freedom) than the few «observable» parameters which are measured. However, by combining a series of measurements, the Kalman filter can estimate the entire internal state.

For the Dempster–Shafer theory, each state equation or observation is considered a special case of a linear belief function and the Kalman filtering is a special case of combining linear belief functions on a join-tree or Markov tree. Additional methods include belief filtering which use Bayes or evidential updates to the state equations.

A wide variety of Kalman filters exists by now, from Kalman’s original formulation — now termed the «simple» Kalman filter, the Kalman–Bucy filter, Schmidt’s «extended» filter, the information filter, and a variety of «square-root» filters that were developed by Bierman, Thornton, and many others. Perhaps the most commonly used type of very simple Kalman filter is the phase-locked loop, which is now ubiquitous in radios, especially frequency modulation (FM) radios, television sets, satellite communications receivers, outer space communications systems, and nearly any other electronic communications equipment.

Underlying dynamic system model[edit]

|

This section needs expansion. You can help by adding to it. (August 2011) |

Kalman filtering is based on linear dynamic systems discretized in the time domain. They are modeled on a Markov chain built on linear operators perturbed by errors that may include Gaussian noise. The state of the target system refers to the ground truth (yet hidden) system configuration of interest, which is represented as a vector of real numbers. At each discrete time increment, a linear operator is applied to the state to generate the new state, with some noise mixed in, and optionally some information from the controls on the system if they are known. Then, another linear operator mixed with more noise generates the measurable outputs (i.e., observation) from the true («hidden») state. The Kalman filter may be regarded as analogous to the hidden Markov model, with the difference that the hidden state variables have values in a continuous space as opposed to a discrete state space as for the hidden Markov model. There is a strong analogy between the equations of a Kalman Filter and those of the hidden Markov model. A review of this and other models is given in Roweis and Ghahramani (1999)[24] and Hamilton (1994), Chapter 13.[25]

In order to use the Kalman filter to estimate the internal state of a process given only a sequence of noisy observations, one must model the process in accordance with the following framework. This means specifying the matrices, for each time-step k, following:

- Fk, the state-transition model;

- Hk, the observation model;

- Qk, the covariance of the process noise;

- Rk, the covariance of the observation noise;

- and sometimes Bk, the control-input model as described below; if Bk is included, then there is also

- uk, the control vector, representing the controlling input into control-input model.

Model underlying the Kalman filter. Squares represent matrices. Ellipses represent multivariate normal distributions (with the mean and covariance matrix enclosed). Unenclosed values are vectors. For the simple case, the various matrices are constant with time, and thus the subscripts are not used, but Kalman filtering allows any of them to change each time step.

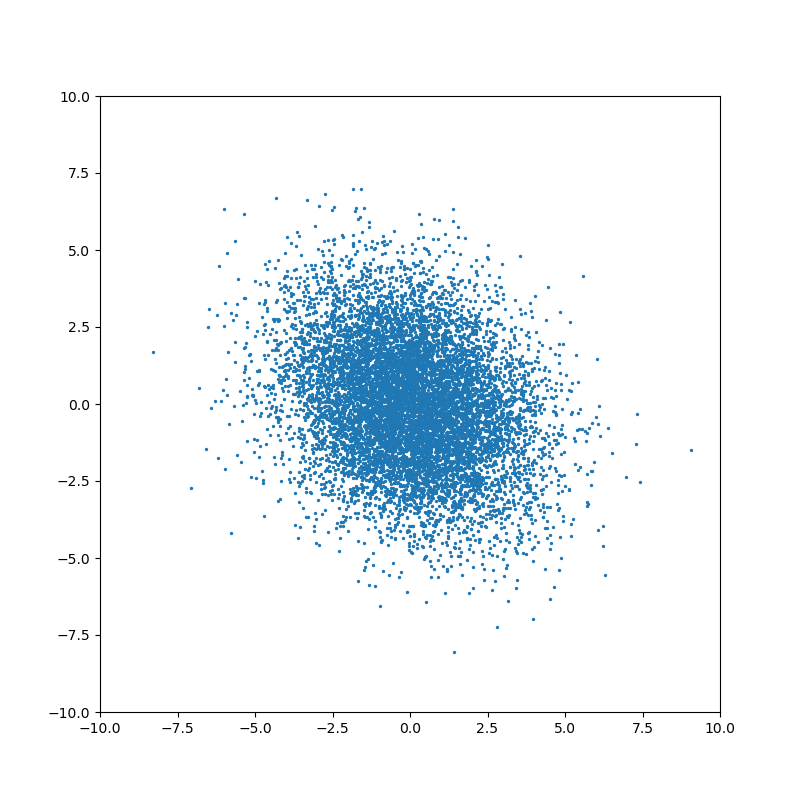

The Kalman filter model assumes the true state at time k is evolved from the state at (k − 1) according to

where

At time k an observation (or measurement) zk of the true state xk is made according to

where

- Hk is the observation model, which maps the true state space into the observed space and

- vk is the observation noise, which is assumed to be zero mean Gaussian white noise with covariance Rk:

.

The initial state, and the noise vectors at each step {x0, w1, …, wk, v1, … ,vk} are all assumed to be mutually independent.

Many real-time dynamic systems do not exactly conform to this model. In fact, unmodeled dynamics can seriously degrade the filter performance, even when it was supposed to work with unknown stochastic signals as inputs. The reason for this is that the effect of unmodeled dynamics depends on the input, and, therefore, can bring the estimation algorithm to instability (it diverges). On the other hand, independent white noise signals will not make the algorithm diverge. The problem of distinguishing between measurement noise and unmodeled dynamics is a difficult one and is treated as a problem of control theory using robust control.[26][27]

Details[edit]

The Kalman filter is a recursive estimator. This means that only the estimated state from the previous time step and the current measurement are needed to compute the estimate for the current state. In contrast to batch estimation techniques, no history of observations and/or estimates is required. In what follows, the notation

The state of the filter is represented by two variables:

The algorithm structure of the Kalman filter resembles that of Alpha beta filter. The Kalman filter can be written as a single equation; however, it is most often conceptualized as two distinct phases: «Predict» and «Update». The predict phase uses the state estimate from the previous timestep to produce an estimate of the state at the current timestep. This predicted state estimate is also known as the a priori state estimate because, although it is an estimate of the state at the current timestep, it does not include observation information from the current timestep. In the update phase, the innovation (the pre-fit residual), i.e. the difference between the current a priori prediction and the current observation information, is multiplied by the optimal Kalman gain and combined with the previous state estimate to refine the state estimate. This improved estimate based on the current observation is termed the a posteriori state estimate.

Typically, the two phases alternate, with the prediction advancing the state until the next scheduled observation, and the update incorporating the observation. However, this is not necessary; if an observation is unavailable for some reason, the update may be skipped and multiple prediction procedures performed. Likewise, if multiple independent observations are available at the same time, multiple update procedures may be performed (typically with different observation matrices Hk).[28][29]

Predict[edit]

Update[edit]

| Innovation or measurement pre-fit residual |

|

| Innovation (or pre-fit residual) covariance |

|

| Optimal Kalman gain |

|

| Updated (a posteriori) state estimate |

|

| Updated (a posteriori) estimate covariance |

|

| Measurement post-fit residual |

|

The formula for the updated (a posteriori) estimate covariance above is valid for the optimal Kk gain that minimizes the residual error, in which form it is most widely used in applications. Proof of the formulae is found in the derivations section, where the formula valid for any Kk is also shown.

A more intuitive way to express the updated state estimate (

This expression reminds us of a linear interpolation,

In our case:

This expression also resembles the alpha beta filter update step.

Invariants[edit]

If the model is accurate, and the values for

where ![{displaystyle operatorname {E} [xi ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/261957bffe5d89e65e9d27dfa34c5f86f6017baa)

Also:

so covariance matrices accurately reflect the covariance of estimates.

Estimation of the noise covariances Qk and Rk[edit]

Practical implementation of a Kalman Filter is often difficult due to the difficulty of getting a good estimate of the noise covariance matrices Qk and Rk. Extensive research has been done to estimate these covariances from data. One practical method of doing this is the autocovariance least-squares (ALS) technique that uses the time-lagged autocovariances of routine operating data to estimate the covariances.[30][31] The GNU Octave and Matlab code used to calculate the noise covariance matrices using the ALS technique is available online using the GNU General Public License.[32] Field Kalman Filter (FKF), a Bayesian algorithm, which allows simultaneous estimation of the state, parameters and noise covariance has been proposed.[33] The FKF algorithm has a recursive formulation, good observed convergence, and relatively low complexity, thus suggesting that the FKF algorithm may possibly be a worthwhile alternative to the Autocovariance Least-Squares methods.

Optimality and performance[edit]

It follows from theory that the Kalman filter is the optimal linear filter in cases where a) the model matches the real system perfectly, b) the entering noise is «white» (uncorrelated) and c) the covariances of the noise are known exactly. Correlated noises can also be treated using Kalman filters.[34]

Several methods for the noise covariance estimation have been proposed during past decades, including ALS, mentioned in the section above. After the covariances are estimated, it is useful to evaluate the performance of the filter; i.e., whether it is possible to improve the state estimation quality. If the Kalman filter works optimally, the innovation sequence (the output prediction error) is a white noise, therefore the whiteness property of the innovations measures filter performance. Several different methods can be used for this purpose.[35] If the noise terms are distributed in a non-Gaussian manner, methods for assessing performance of the filter estimate, which use probability inequalities or large-sample theory, are known in the literature.[36][37]

Example application, technical[edit]

Truth;

filtered process;

observations.

Consider a truck on frictionless, straight rails. Initially, the truck is stationary at position 0, but it is buffeted this way and that by random uncontrolled forces. We measure the position of the truck every Δt seconds, but these measurements are imprecise; we want to maintain a model of the truck’s position and velocity. We show here how we derive the model from which we create our Kalman filter.

Since

The position and velocity of the truck are described by the linear state space

where

We assume that between the (k − 1) and k timestep, uncontrolled forces cause a constant acceleration of ak that is normally distributed with mean 0 and standard deviation σa. From Newton’s laws of motion we conclude that

(there is no

so that

where

The matrix

At each time phase, a noisy measurement of the true position of the truck is made. Let us suppose the measurement noise vk is also distributed normally, with mean 0 and standard deviation σz.

where

and

We know the initial starting state of the truck with perfect precision, so we initialize

and to tell the filter that we know the exact position and velocity, we give it a zero covariance matrix:

If the initial position and velocity are not known perfectly, the covariance matrix should be initialized with suitable variances on its diagonal:

The filter will then prefer the information from the first measurements over the information already in the model.

Asymptotic form[edit]

For simplicity, assume that the control input

A similar equation holds if we include a non-zero control input. Gain matrices

Since the gain matrices depend only on the model, and not the measurements, they may be computed offline. Convergence of the gain matrices

Using the asymptotic gain, and assuming

The asymptotic gain

The asymptotic gain is then computed as before.

Additionally, a form of the asymptotic Kalman filter more commonly used in control theory is given by

where

This leads to an estimator of the form

Derivations[edit]

The Kalman filter can be derived as a generalized least squares method operating on previous data.[39]

Deriving the posteriori estimate covariance matrix[edit]

Starting with our invariant on the error covariance Pk | k as above

substitute in the definition of

and substitute

and

and by collecting the error vectors we get

Since the measurement error vk is uncorrelated with the other terms, this becomes

by the properties of vector covariance this becomes

which, using our invariant on Pk | k−1 and the definition of Rk becomes

This formula (sometimes known as the Joseph form of the covariance update equation) is valid for any value of Kk. It turns out that if Kk is the optimal Kalman gain, this can be simplified further as shown below.

Kalman gain derivation[edit]

The Kalman filter is a minimum mean-square error estimator. The error in the a posteriori state estimation is

We seek to minimize the expected value of the square of the magnitude of this vector, ![{displaystyle operatorname {E} left[left|mathbf {x} _{k}-{hat {mathbf {x} }}_{k|k}right|^{2}right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9980afd591249f61711d6020cb30a0bcd54ec641)

The trace is minimized when its matrix derivative with respect to the gain matrix is zero. Using the gradient matrix rules and the symmetry of the matrices involved we find that

Solving this for Kk yields the Kalman gain:

This gain, which is known as the optimal Kalman gain, is the one that yields MMSE estimates when used.

Simplification of the posteriori error covariance formula[edit]

The formula used to calculate the a posteriori error covariance can be simplified when the Kalman gain equals the optimal value derived above. Multiplying both sides of our Kalman gain formula on the right by SkKkT, it follows that

Referring back to our expanded formula for the a posteriori error covariance,

we find the last two terms cancel out, giving

This formula is computationally cheaper and thus nearly always used in practice, but is only correct for the optimal gain. If arithmetic precision is unusually low causing problems with numerical stability, or if a non-optimal Kalman gain is deliberately used, this simplification cannot be applied; the a posteriori error covariance formula as derived above (Joseph form) must be used.

Sensitivity analysis[edit]

The Kalman filtering equations provide an estimate of the state

no longer provides the actual error covariance. In other words, ![{displaystyle mathbf {P} _{kmid k}neq Eleft[left(mathbf {x} _{k}-{hat {mathbf {x} }}_{kmid k}right)left(mathbf {x} _{k}-{hat {mathbf {x} }}_{kmid k}right)^{textsf {T}}right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/14f468d3696299953a87882fe8987d019be46f87)

This discussion is limited to the error sensitivity analysis for the case of statistical uncertainties. Here the actual noise covariances are denoted by

![{displaystyle mathbf {P} _{kmid k}^{a}=Eleft[left(mathbf {x} _{k}-{hat {mathbf {x} }}_{kmid k}right)left(mathbf {x} _{k}-{hat {mathbf {x} }}_{kmid k}right)^{textsf {T}}right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b8bfa69cc3749d0b62c6d50dc98080b54b24ea12)

and using the fact that ![{displaystyle Eleft[mathbf {w} _{k}mathbf {w} _{k}^{textsf {T}}right]=mathbf {Q} _{k}^{a}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d683b5e826696f9302ad471107d89cbd574a2861)

![{displaystyle Eleft[mathbf {v} _{k}mathbf {v} _{k}^{textsf {T}}right]=mathbf {R} _{k}^{a}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d89dca74f5288b67fbe0fa2855a370545ddb4006)

and

While computing

![{displaystyle Eleft[mathbf {w} _{k}mathbf {w} _{k}^{textsf {T}}right]=mathbf {Q} _{k}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3e913b662d3d03c3b59ce4a86767ae6c4a57c311)

![{displaystyle Eleft[mathbf {v} _{k}mathbf {v} _{k}^{textsf {T}}right]=mathbf {R} _{k}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/819ee3b84d0b2613dc716ed09927696fda25baf5)

Square root form[edit]

One problem with the Kalman filter is its numerical stability. If the process noise covariance Qk is small, round-off error often causes a small positive eigenvalue to be computed as a negative number. This renders the numerical representation of the state covariance matrix P indefinite, while its true form is positive-definite.

Positive definite matrices have the property that they have a triangular matrix square root P = S·ST. This can be computed efficiently using the Cholesky factorization algorithm, but more importantly, if the covariance is kept in this form, it can never have a negative diagonal or become asymmetric. An equivalent form, which avoids many of the square root operations required by the matrix square root yet preserves the desirable numerical properties, is the U-D decomposition form, P = U·D·UT, where U is a unit triangular matrix (with unit diagonal), and D is a diagonal matrix.

Between the two, the U-D factorization uses the same amount of storage, and somewhat less computation, and is the most commonly used square root form. (Early literature on the relative efficiency is somewhat misleading, as it assumed that square roots were much more time-consuming than divisions,[42]: 69 while on 21st-century computers they are only slightly more expensive.)

Efficient algorithms for the Kalman prediction and update steps in the square root form were developed by G. J. Bierman and C. L. Thornton.[42][43]